Το να μιλάμε διαρκώς για τους κινδύνους που κρύβονται πίσω από τα εργαλεία τεχνητής νοημοσύνης δεν έχει πλέον νόημα: Οι κίνδυνοι δεν βρίσκονται πλέον στη θεωρία, αλλά μπορούν να κατακλύσουν μία ολόκληρη πλατφόρμα κοινωνικής δικτύωσης.

View this post on Instagram

Την εβδομάδα που πέρασε, το Χ, μέχρι πρότινος γνωστό ως Twitter, γέμισε με γυμνές, ψεύτικες φωτογραφίες της τραγουδίστριας Taylor Swift, που είχαν δημιουργηθεί με τη βοήθεια της τεχνητής νοημοσύνης. Μάλιστα, η πηγή τους παραμένει ακόμα άγνωστη. Ακόμα κι αν έχουμε μάθει, πλέον, ως έναν βαθμό, να διακρίνουμε τι είναι αληθινό και τι deepfake, πάντα θα βρεθούν κάποιοι που θα εκμεταλλευτούν την ευκαιρία ευτελισμού κάποιου προσώπου, δημόσιου ή μη, με αποτέλεσμα το θύμα να βιώνει ένα τραύμα που θα το κυνηγάει για πολύ καιρό, ειδικά για όσο καιρό η πολιτεία δεν φροντίζει για την αποτελεσματική προστασία απέναντι σε τέτοιες καταστάσεις.

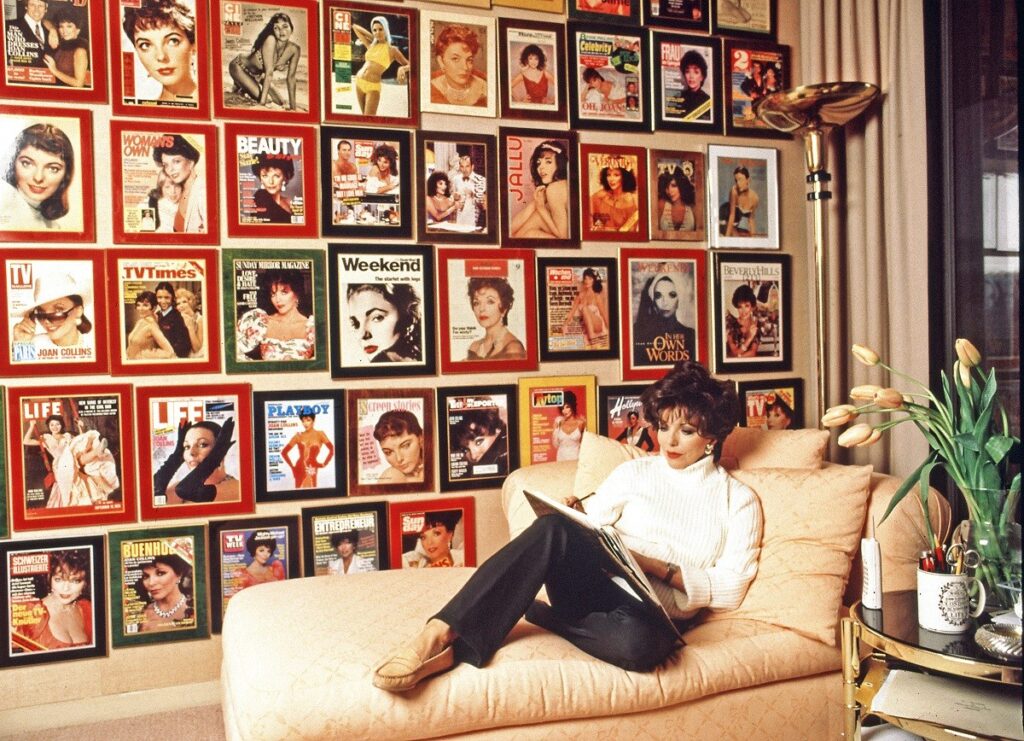

Πριν από λίγο καιρό η ηθοποιός Xochitl Gomez επίσης ανακάλυψε ότι στο Χ υπήρχαν τέτοιες φωτογραφίες της και μάλιστα δεν κατάφερε να πείσει το μέσο να τις κατεβάσει. Η ίδια είναι δεκαεπτά ετών. Το πώς λειτουργεί το Χ ή κάθε πλατφόρμα κοινωνικής δικτύωσης εξαιτίας του ιδιοκτήτη της είναι μία άλλη ιστορία, αλλά το βασικό ζήτημα είναι, ξανά, το γιατί δεν υπάρχει ειδική νομοθεσία που να εφαρμόζεται άμεσα.

View this post on Instagram

Καθένας μπορεί να πέσει θύμα αυτού του είδους της τεχνολογίας και να δει το πρόσωπο ή το σώμα του σε πορνογραφικό υλικό, ωστόσο το 99% των θυμάτων της σύμφωνα με το Sensity AI είναι γυναίκες. Δεν χρειάζεται να πάμε και πολύ μακριά. Πρόσφατα έγινε γνωστό ότι θύματα του ΑΙ υπήρξαν ανήλικα κορίτσια σε γυμνάσιο της Ελλάδας.

Αυτού του είδους η online συμπεριφορά αποτελεί παρενόχληση και στοχεύει στην αποδυνάμωση των γυναικών. Κάθε μία από εμάς είναι και ένα πιθανό θύμα μίας online – και μη – επίθεσης, σε ένα σύστημα που λειτουργεί ήδη με χαοτικό τρόπο.

Σε αρκετές πολιτείες των ΗΠΑ έχει απαγορευτεί το revenge porn και η διάδοση τέτοιου είδους περιεχομένου, αλλά δεν υπάρχει κανένας ομοσπονδιακός νόμος που να αφορά συγκεκριμένα στις deepfake φωτογραφίες. Συνεπώς, είναι πολύ δύσκολο για τα θύματα, είτε ονομάζονται Taylor Swift, είτε Mary Smith, να επιδιώξουν δικαστικά τη δικαίωσή τους για όλη αυτή τη βία που υφίστανται.

Το νομοθετικό σώμα κάθε κράτους πρέπει να θέσει ως προτεραιότητα την προστασία των ανθρώπων από αυτού του είδους τις συμπεριφορές, καθώς όταν τέτοιες καταστάσεις αφήνονται απλώς στον slacktivism των hashtags οπως το #ProtectTaylorSwift, ο κόσμος μεν ενημερώνεται για το τι έχει συμβεί, η κατάσταση όμως δεν διορθώνεται. Κι ας μην ανοίξουμε καν το κεφάλαιο για τις τυχόν deepfake φωτογραφίες με ανηλίκους.

Στη Μεγάλη Βρετανία υπάρχει σχετική νομοθεσία που, ως έναν βαθμό, μπορεί να προστατέψει το θύμα μίας τέτοιας πράξης, ωστόσο παντού στον κόσμο πρέπει να εγκαθιδρυθεί μία κουλτούρα προστασίας των θυμάτων της fake πορνογραφίας. Αυτό θα γίνει αν κάνουμε – πάλι – ως γυναίκες αρκετή φασαρία, online και μη, ώστε να μας δώσουν την ίδια σημασία που κάποιοι μας δίνουν όταν μας βλέπουν γυμνές, ακόμα κι αν δεν είμαστε εμείς, αλλά τα pixels που δημιούργησε ένα ψηφιακό εργαλείο.