Η συζήτηση για την τοξικότητα των μέσων κοινωνικής δικτύωσης δεν πρόκειται να τελειώσει ποτέ, όσο αυτά θα υπάρχουν και όσο θα μπαίνουν στο παιχνίδι των αναρτήσεων, των ιστοριών, των φωτογραφιών και των βίντεο νέοι «παίκτες». Ανάμεσα σε αυτούς δε συμπεριλαμβάνονται μόνο οι άνθρωποι που αποκτούν για πρώτη φορά πρόσβαση σε κάποιο τέτοιο μέσο, αλλά και τα εργαλεία που δημιουργήθηκαν για να διευκολύνουν, θεωρητικά, τη ζωή μας και που τελικά κρύβουν μέσα τους μεγάλες απειλές για την ήρεμη καθημερινότητά μας. Αυτή είναι και η άποψη του ψυχολόγου Jonathan Haidt, καθώς και του πρώην CEO της Google, Eric Schmidt, οι οποίοι τοποθετήθηκαν πρόσφατα σχετικά με την τεχνητή νοημοσύνη, επισημαίνοντας τους κινδύνους που συνεπάγεται για τη λειτουργία των social media και προτείνοντας παράλληλα πιθανούς τρόπους για να περιοριστεί η ζημιά που μπορεί να προκαλέσει.

Ξεκινώντας από τα προφανή, οι Haidt και Schmidt επεσήμαναν το ευρύ πεδίο των προβλημάτων που μαστίζει ήδη τα μέσα κοινωνικής δικτύωσης, όπως η ανεξέλεγκτη διάδοση ακραίων πολιτικών και άλλων θέσεων, καθώς και τα fake news. Το «κάποιος έγραψε κάτι στο Internet» εκλαμβάνεται πολλές φορές δογματικά, ως κάτι που είτε ισχύει σίγουρα είτε δεν ισχύει καθόλου. Το κοινό ήδη δυσκολεύεται να διακρίνει ποιος είναι ο «κάποιος», πώς σχετίζεται με αυτό που αναρτά και τι μπορεί να αποκομίζει κρυφά από το μήνυμα που αφήνει εκεί έξω. Η «Internet etiquette», γνωστή και ως «netiquette» (δηλαδή οι καλές πρακτικές με τις οποίες πραγματοποιείται η επικοινωνία στο διαδίκτυο με τον κατάλληλο για κάθε περίσταση τρόπο και με σεβασμό στον συνομιλητή – και όχι μόνο) έχει φθίνει ήδη σημαντικά, ακόμα και σε κοινωνίες που έχουν θεωρητικά μεγαλύτερη τριβή με τον online κόσμο. Τι επιπλέον μπορεί, λοιπόν, να προκαλέσει η τεχνητή νοημοσύνη σε αυτό το πεδίο;

Το «κάποιος έγραψε κάτι στο Internet» εκλαμβάνεται πολλές φορές δογματικά, ως κάτι που είτε ισχύει σίγουρα είτε δεν ισχύει καθόλου.

Όσο τα εργαλεία της θα χρησιμοποιούνται από όλο και μεγαλύτερο αριθμό ανθρώπων, τόσο περισσότερο θα εμπλουτίζεται το περιεχόμενο που θα μπορεί να παράξει η τεχνητή νοημοσύνη. Αν, σύμφωνα με τους υπολογισμούς του Techjury, το 62% του περιεχομένου του διαδικτύου δεν είναι αληθινό, πολλές ακόμα πλατφόρμες δημιουργίας περιεχομένου, όπως τα εργαλεία AI, αναμένεται να τροφοδοτήσουν τον παγκόσμιο ιστό με αμέτρητες ψεύτικες πληροφορίες, απέναντι στις οποίες ο μέσος άνθρωπος θα είναι απροστάτευτος. Κι αν «καταναλώσει» πολλές φορές τέτοιου είδους ψευδείς ειδήσεις, γεγονότα, κ.λπ., τότε η εμπιστοσύνη στους θεσμούς, την πολιτεία, αλλά και τον απλό συνάνθρωπο με τον οποίο συνομιλεί, θα αρχίσει να μειώνεται καταλυτικά.

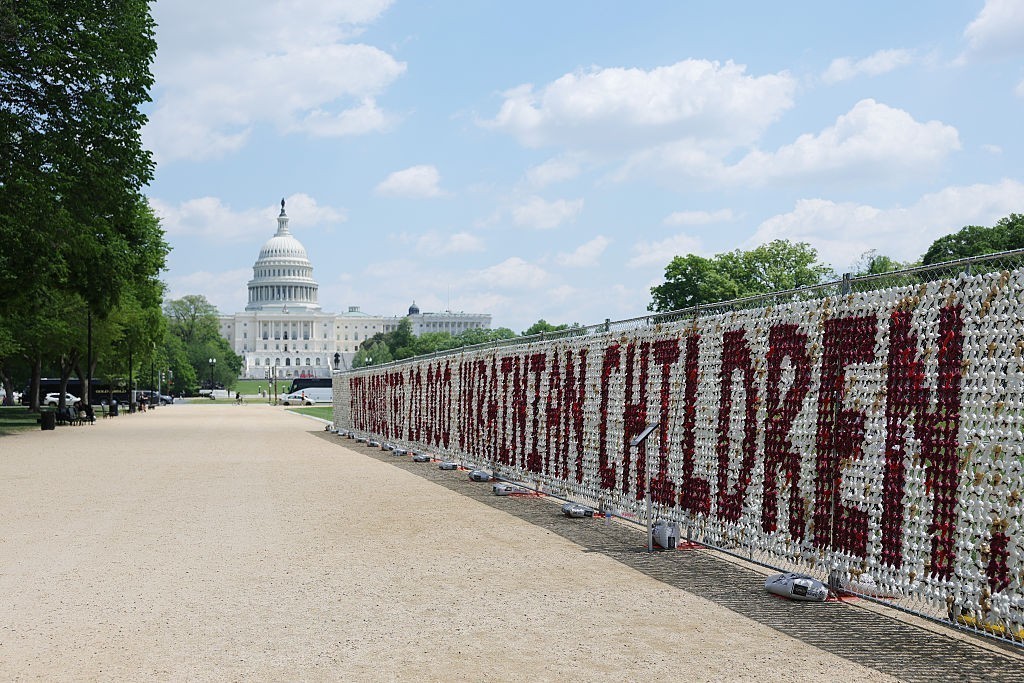

Τα πράγματα θα είναι ακόμα πιο επικίνδυνα αν τα ψέματα και οι ανακρίβειες με τις οποίες θα εμπλουτιστούν τα εργαλεία ΑΙ αποτελέσουν προϊόντα ειδικού σχεδιασμού από ανθρώπους, οργανισμούς και οποιονδήποτε άλλο μπορεί να δημιουργήσει μια τέτοια «καμπάνια» με χειριστικό σκοπό. Ήδη αυτό έχει επιχειρηθεί σε διάφορες κρίσιμες ιστορικές καταστάσεις, όπως οι προεδρικές εκλογές των ΗΠΑ. Και προφανώς επιχειρείται ήδη από τυραννικά καθεστώτα, τα οποία μελλοντικά θα έχουν τη δυνατότητα να εκμεταλλευτούν την τεχνητή νοημοσύνη με τρόπο ώστε να παρακολουθούν άμεσα όχι μόνο τυχόν αντιφρονούντες, αλλά οποιονδήποτε πολίτη.

Τα εργαλεία ΑΙ, αν παραμείνουν ανεξέλεγκτα, είναι το βούτυρο στο ψωμί κάθε καθεστώτος που ήδη ελέγχει τα παραδοσιακά μέσα ενημέρωσης.

Τα εργαλεία ΑΙ, αν παραμείνουν ανεξέλεγκτα, είναι το βούτυρο στο ψωμί κάθε καθεστώτος που ήδη ελέγχει τα παραδοσιακά μέσα ενημέρωσης. Όλα θα προσαρμοστούν στις ανάγκες και τα ενδιαφέροντα των ανθρώπων, που θα λαμβάνουν ψεύτικη, επιζήμια πληροφόρηση, την οποία θα μπορούν εύκολα να πιστέψουν και να αναπαράξουν. Και, βέβαια, αυτό το οποίο θα επηρεαστεί πέρα και πάνω από όλα, είναι η συλλογική ψυχική μας υγεία. Ειδικά στην περίπτωση των παιδιών και των εφήβων, που συχνότατα ξεκινούν να χρησιμοποιούν το Ίντερνετ χωρίς να έχουν βασικές γνώσεις σχετικά με το πώς π.χ. μπορεί να γίνει εκμετάλλευση των προσωπικών τους δεδομένων, ο κίνδυνος να εμφανίσουν προβλήματα ψυχικής υγείας όπως η κατάθλιψη και η αγχώδης διαταραχή είναι εξαιρετικά μεγάλος. Ειδικά αν αναλογιστούμε πως αυτό έχει συμβεί ήδη από τη διάδοση χρήσης των social media σε ένα μεγάλο ποσοστό εφήβων την περασμένη δεκαετία, κατά την οποία δεν υπήρχε και τίποτα που έστω να θυμίζει τα εργαλεία ΑΙ.

Απέναντι σε όλες αυτές τις προκλήσεις, και με δεδομένο ότι θέλουμε τα εργαλεία ΑΙ για τα οφέλη που μας προσφέρουν και συνεπώς δεν επιθυμούμε να καταργήσουμε τη χρήση τους, ούτε να προκαλέσουμε κάποιον «ΑΙ πανικό», οι Haidt και Schmidt πρότειναν διάφορους τρόπους ώστε να μειωθεί ο όποιος κίνδυνος παραμονεύει ανάμεσα σε λίγες γραμμές κώδικα και πολλά δάχτυλα που πληκτρολογούν με κρυφές ατζέντες στο μυαλό τους.

Μια πρόταση που έκαναν στο περιοδικό The Atlantic ήταν τεχνικού περιεχομένου και αφορούσε στην υποχρεωτική επισήμανση του οπτικού και ακουστικού περιεχομένου που δημιουργείται από λογαριασμούς που δεν ελέγχονται από ανθρώπινο χέρι.

Στο ίδιο πλαίσιο, επισημαίνεται πως πρέπει να μπει στο παιχνίδι και η ευθύνη των εταιρειών πίσω από τις πλατφόρμες, δηλαδή να μπορεί κάποιος ο οποίος ζημιώθηκε με κάποιο τρόπο από περιεχόμενο ΑΙ που δεν ελέγχθηκε σωστά να ζητήσει π.χ. αποζημίωση, κάτι το οποίο θα εξαναγκάσει τις εταιρείες να βρουν από μόνες τους τρόπους ώστε το περιεχόμενο που προσφέρουν να ανταποκρίνεται στην πραγματικότητα. Βέβαια, εδώ υπάρχει και το ζήτημα των ίδιων των χρηστών, οι οποίοι θα πρέπει να ενθαρρυνθούν να χρησιμοποιούν τις πλατφόρμες με «netiquette», χωρίς να προτίθενται δηλαδή να εξαπατήσουν κάποιους, να πουν καταφανή ψέματα, να διαστρεβλώσουν την πραγματικότητα, κ.ο.κ.

Πρέπει να μπει στο παιχνίδι και η ευθύνη των εταιρειών πίσω από τις πλατφόρμες, δηλαδή να μπορεί κάποιος ο οποίος ζημιώθηκε με κάποιο τρόπο από περιεχόμενο ΑΙ που δεν ελέγχθηκε σωστά να ζητήσει π.χ. αποζημίωση.

Το πρόβλημα με όλες αυτές τις προτεινόμενες λύσεις είναι πολυεπίπεδο. Καταρχάς δε γνωρίζουμε αν οι εταιρείες ΑΙ είναι διατεθειμένες να ρυθμιστούν νομοθετικά για το περιεχόμενό τους, και η απάντηση μάλλον θα είναι, σε πρώτο επίπεδο, αρνητική, έστω και για τεχνικούς λόγους. Επίσης, είναι τρομακτικά δύσκολο να εφαρμοστεί οποιαδήποτε «Ιντερνετική δεοντολογία» σε μέσα ενημέρωσης και κοινωνικής δικτύωσης που ελέγχονται από απολυταρχικά καθεστώτα.

Το να επισημαίνεται, επιπλέον, ποιο υλικό είναι προϊόν τεχνητής νοημοσύνης και ποιο όχι ενέχει τη δυσκολία της προστασίας ενός θεμελιώδους δικαιώματος και συγκεκριμένα της ελευθερίας της έκφρασης. Αν εγώ π.χ. μιλάω μέτρια αγγλικά και ζητήσω από ένα εργαλείο να μου ξαναγράψει ένα δικό μου κείμενο, θα πρέπει αυτό να επισημανθεί πως προέκυψε τεχνητά; Κι αν ναι, πώς; Η ελευθερία της έκφρασης, η οποία με βάση τα παραπάνω δεδομένα θα πρέπει να περιορίζεται κατά τη χρήση της ΑΙ, είναι το βασικότερο, ίσως, ζήτημα που πρέπει να λάβουν υπόψιν όσοι θα μπορέσουν να προτείνουν ή και να εφαρμόσουν λύσεις στα πιο πάνω προβλήματα. Είμαστε διατεθειμένοι να περπατήσουμε σε αυτό το δύσκολο μονοπάτι, με τις απρόβλεπτες εκπλήξεις;

Όλα όσα προτείνουν οι Haidt και Schmidt δεν είναι άμεσα εφαρμόσιμα – κάποια ίσως και καθόλου – ωστόσο αποτελούν ένα καλό σημείο για να ξεκινήσει η συζήτηση γύρω από το πώς διαμορφώνονται τα νέα online ήθη και τι μπορεί να κάνει καθένας μας για να μην επιβαρύνει την κατάσταση. Όλοι θυμόμαστε τη «φωτογραφία» του Πάπα Φραγκίσκου με το φουσκωτό λευκό μπουφάν διάσημου οίκου. Αν αυτό συνέβαινε με κάτι πιο σοβαρό από ό,τι η στάνταρ εξωτερική εμφάνιση του Ποντίφικα, όπως για παράδειγμα μια «φωτογραφία» από πόλεμο που δεν υπάρχει, θα γελούσαμε το ίδιο; Μάλλον όχι. Ούτε κι ο Πάπας, κι ας έχει αρκετό χιούμορ.